Почему важно декомпозировать задачу при работе с LLM: путь к точности, контролю и экономии

Большие языковые модели (LLM) сегодня используются для генерации текстов, аналитики, программирования, поддержки клиентов, обработки документов и множества других задач. Однако многие пользователи сталкиваются с одной и той же проблемой: чем сложнее запрос, тем выше вероятность получить размытый, неполный или даже ошибочный результат.

Причина проста, LLM лучше справляются не с объемной задачей, изложенной в промпте, а с последовательными, четко ограниченными шагами. Именно поэтому декомпозиция задачи - один из ключевых принципов эффективной работы с нейросетями.

Проблема одного большого промпта

Типичная ошибка — отправлять в модель сразу всё:

- описание задачи,

- требования к стилю,

- ограничения,

- входные данные,

- желаемый формат результата,

- дополнительные условия.

В итоге модель вынуждена одновременно удерживать в контексте множество требований, строить план решения и сразу выдавать финальный результат. Даже сильные модели иногда “срезают углы”: пропускают детали, неправильно интерпретируют требования или начинают фантазировать.

Особенно это заметно, если используется не очень мощная модель, например Gigachat или аналогичные решения.

Что дает декомпозиция задачи

Декомпозиция - это подход, при котором задача разбивается на цепочку простых этапов. На каждом этапе задается отдельный промпт с конкретной целью. Результат одного этапа передается в следующий.

Примерно так:

- Модель анализирует задачу и формирует план.

- Далее выделяет ключевые сущности или структуру данных.

- Затем генерирует текст по структуре.

- Потом проверяет себя и исправляет ошибки.

- В конце форматирует результат под требования.

И это работает значительно лучше, чем один “универсальный” промпт.

Почему цепочка промптов повышает точность

1. Модель меньше ошибается в логике

LLM часто допускают логические ошибки, когда вынуждены решать задачу целиком. Но если каждый шаг ограничен узкой функцией (например, “составь план”, “выдели тезисы”, “перепиши в официальном стиле”), вероятность ошибки резко снижается.

Модель перестает “угадывать” результат и начинает выполнять понятные действия.

2. Каждый этап можно контролировать

При одном большом запросе вы не знаете, где модель ошиблась: в понимании задачи, в выводах или в оформлении.

При декомпозиции появляется контроль:

- можно проверить промежуточный результат,

- при необходимости скорректировать входные данные,

- повторить конкретный шаг, а не всю задачу.

Это особенно важно для бизнес-процессов, где ошибка может стоить денег.

3. Снижается нагрузка на контекст

Когда задача разбита на этапы, в каждом промпте используется только нужная информация. Модель не перегружается лишними деталями.

Это критично, если:

- контекст ограничен,

- используется недорогая модель,

- данные большие (например, документы, переписки, отчеты).

4. Можно использовать более простые и дешевые модели

Главное преимущество декомпозиции - она позволяет добиваться качества “как у сильных моделей”, даже если используется модель среднего уровня.

Например, Gigachat или DeepSeek могут выдавать отличный результат, если:

- сначала попросить выделить структуру,

- потом сформировать аргументы,

- потом собрать текст,

- затем выполнить самопроверку.

То есть качество достигается не только мощностью модели, но и грамотной организацией процесса.

5. Модель можно заставить проверять себя

Один из самых сильных приемов - добавлять этап проверки и исправления.

Например:

- “Проверь текст на логические противоречия”

- “Найди слабые аргументы”

- “Убери воду и повторения”

- “Приведи к единому стилю”

LLM хорошо справляются с ролью редактора, особенно если редактируют уже готовый материал.

Декомпозиция как приближение к настоящему мышлению

Человек тоже редко решает сложную задачу единым умственным усилием.

Обычно мы решаем задач примерно так:

- сначала думаем, что нужно сделать,

- для сложных задач составляем план

- делаем черновик,

- улучшаем,

- исправляем,

- проверяем.

Декомпозиция - это способ заставить LLM работать по похожей схеме. И именно в этом скрыт рост качества.

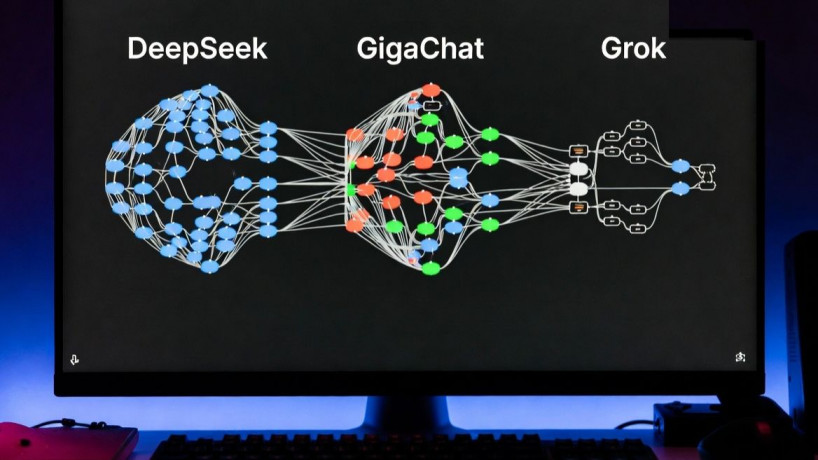

Оркестрация LLM: когда на каждом этапе своя модель

Следующий уровень совершенствования - это использование разных моделей на разных этапах.

Например:

- одна модель хорошо анализирует и структурирует,

- другая лучше пишет тексты,

- третья сильнее в проверке фактов,

- четвертая дешевле и подходит для рутинных шагов.

Такой подход называется оркестрацией LLM: когда несколько моделей работают как “команда”, а не как один универсальный исполнитель.

В результате достигается баланс:

- качество выше,

- стоимость ниже,

- скорость обработки больше,

- процессы становятся предсказуемыми.

Почему это особенно важно для бизнеса

В бизнесе LLM часто применяют в процессах, где важны:

- стабильность результата,

- повторяемость,

- прозрачность,

- минимизация ошибок.

Один большой промпт редко дает повторяемый результат: модель может менять структуру ответа, стиль, забывать требования.

А декомпозиция превращает генерацию в управляемый процесс, похожий на конвейер:

- входные данные → этап обработки → этап генерации → этап контроля → финальный результат.

Это уже не “чат с нейросетью” с непредсказуемым результатом, а полноценный инструмент автоматизации.

Как Botman.one решает задачу декомпозиции

Low-code платформа Botman.one позволяет реализовать такой подход без сложной разработки.

Вместо того чтобы вручную копировать результаты между промптами, можно собрать алгоритмическую цепочку этапов в виде сценария:

- каждый шаг это отдельный блок,

- результат автоматически передается дальше,

- можно задавать условия (ветвления алгоритма) в зависимости от полученных на каждом этапе результатов,

- можно сохранять промежуточные данные,

- можно подключать внешние источники информации.

Важно еще и то, что Botman.one позволяет использовать разные LLM на каждом этапе.

Например:

- шаг анализа выполнить через Gigachat,

- генерацию текста - через DeepSeek,

- финальную редактуру - через более точную ChatGPT или Gemini,

- классификацию или разметку - через Claude.

Так создается оркестратор LLM, где модели используются максимально рационально.

Посмотрите видео, как этот подход можн реализовать на платформе Botman.one: ссылка.

Практический пример цепочки промптов

Допустим, нужно подготовить коммерческое предложение.

Один промпт:

“Сделай коммерческое предложение по этим данным…”

Часто приводит к слабому тексту: много воды, мало структуры, ошибки в акцентах.

Декомпозиция:

- Промпт 1:

“Выдели ключевые преимущества продукта и боли клиента.” - Промпт 2:

“Составь структуру коммерческого предложения на основе этих преимуществ.” - Промпт 3:

“Напиши текст по структуре, стиль - деловой, объем - 1 страница.” - Промпт 4:

“Сократи текст на 30%, убери повторения.” - Промпт 5:

“Проверь на убедительность и добавь сильный призыв к действию.”

Результат при деокомпозиции будет заметно качественнее, даже если используется не самая дорогая модель.

Декомпозиция задач – хороший способ превратить LLM в надежный инструмент

Разбиение задачи на этапы дает:

- более точный результат,

- меньше ошибок,

- контроль над процессом,

- возможность проверки,

- снижение затрат,

- гибкость в выборе моделей.

Botman.one позволяют реализовать изложенный выше подход: строить алгоритмические цепочки промптов, подключать разные LLM и создавать полноценного оркестратора нейросетей.

В итоге пользователь получает не просто “ответ модели”, а управляемый интеллектуальный процесс, который можно масштабировать и внедрять в реальные бизнес-задачи.

Проходите бесплатный курс по legaltech: ссылка

Пользуйтесь базой знаний legaltech: ссылка

Заходите в Телеграм-группу, где мы обсуждаем технологии: ссылка

Смотрите наши обучающие видео: ссылка